Un siglo de evolución en hardware de cámaras de seguridad y ópticas de imágenes

La prehistoria mecánica: de la grabación cinética a los prototipos de circuito cerrado

La trayectoria técnica de las cámaras de seguridad no fue un éxito de la noche a la mañana, sino una evolución interdisciplinaria que abarcó dos siglos. Sus raíces se remontan a finales del siglo XIX con los primeros intentos de capturar imágenes dinámicas continuas. En 1870, el inventor inglés Wordsworth Donisthorpe patentó el "kinesiógrafo", una cámara de imágenes en movimiento diseñada para tomar una serie de fotografías a intervalos establecidos para capturar el movimiento.1En 1889, Donisthorpe y Louis Le Prince perfeccionaron aún más las cámaras de película y la tecnología de proyección; Le Prince incluso desarrolló una cámara de 16 lentes que, si bien en ese momento era más una herramienta experimental, sentó las bases físicas para el monitoreo continuo en espacios específicos.1

El primer verdadero sistema de circuito cerrado de televisión (CCTV) nació de las necesidades militares durante la Segunda Guerra Mundial. En 1942, al ingeniero alemán Walter Bruch se le encomendó la tarea de diseñar y supervisar un sistema para monitorear los lanzamientos de cohetes A4 (V-2) desde un búnker seguro.1El núcleo de este sistema era su naturaleza de "circuito cerrado", lo que significaba que las señales de vídeo se transmitían sólo a monitores preestablecidos y no públicos. La tecnología de imágenes de la época se basaba enteramente en voluminosos tubos de vacío y complejos circuitos analógicos, sin medios de grabación. El personal de seguridad tuvo que vigilar los monitores en tiempo real, ya que la información se perdía para siempre una vez que desaparecía la imagen.2

En 1949, la empresa estadounidense Vericon lanzó el primer sistema CCTV comercial, marcando la transición del sector militar al comercial y civil.3Estos primeros sistemas comerciales utilizaban principalmente cámaras fijas en blanco y negro conectadas mediante cables coaxiales. Debido al alto calor, el alto consumo de energía y los requisitos de 110 V CA de los tubos de vacío, la instalación era estrictamente limitada y a menudo requería que la cámara estuviera a menos de 6 pies de una toma de corriente.5Además, el rendimiento óptico era extremadamente limitado, con resoluciones de sólo 240 líneas.

El pico y los peligros de los tubos de vacío: Vidicons versus Plumbicons

Antes de que madurara la tecnología de imágenes de semiconductores, los tubos de vacío (Pick-up Tubes) eran el único núcleo de las cámaras de seguridad. Estos dispositivos eran esencialmente tubos de rayos catódicos (CRT) que funcionaban al revés. En la década de 1950, Weimer, Forgue y Goodrich de RCA desarrollaron el Vidicon, un tubo de cámara de tipo almacenamiento que utilizaba un semiconductor fotosensible (inicialmente trisulfuro de antimonio) como objetivo.7

Mecanismo físico y limitaciones materiales.

El principio de funcionamiento de un tubo de cámara implica enfocar una escena en un objetivo fotosensible a través de una lente óptica, que luego es escaneada por un haz de electrones de baja velocidad procedente de un cañón de electrones. Cuando la luz incide en el objetivo, la conductividad local cambia, lo que hace que la corriente del haz de electrones fluctúe y convierta la luz en señales de vídeo.8Vidicón redujo significativamente el tamaño y el costo de la cámara, convirtiéndola en el estándar para vigilancia sin transmisión.7

Sin embargo, el Vidicon sufrió un defecto fatal de "quemado". Si se apunta al sol, a superficies altamente reflectantes o a puntos de luz brillantes durante demasiado tiempo, el objetivo fotosensible sufriría daños físicos permanentes, creando "puntos ciegos".8Además, los Vidicons eran susceptibles al "efecto microfónico", donde los ruidos fuertes o las explosiones provocaban vibraciones físicas en el objetivo de película delgada, produciendo barras horizontales en la pantalla.8

Para superar la baja sensibilidad y el severo "rastreo" (colas de cometa) del Vidicon, Philips introdujo el Plumbicon en la década de 1960. Utilizando óxido de plomo como objetivo, Plumbicon ofrecía altas relaciones señal-ruido y un retraso de imagen extremadamente bajo.7Si bien tuvo éxito en la radiodifusión, su alto costo limitó su uso en seguridad a aplicaciones de alto nivel. No fue hasta finales de la década de 1970, con la evolución de la tecnología de poca luz como el Tivicon (tubo de diodo de silicio) y el Newvicon (producido por Panasonic), que los tubos de vacío cumplieron con las necesidades básicas del monitoreo nocturno.10

La siguiente tabla resume la evolución de las primeras cámaras de seguridad con tubo de vacío:

| Fase Técnica | Sensor central | Año representativo | Líneas de televisión | Características clave | Limitaciones |

| Iniciación | Primeros tubos fotoeléctricos | 1942 | 100-200 | Uso militar, observación en tiempo real. |

Extremadamente voluminoso, sin grabación4 |

| Comercialización | Vidicón | década de 1950 | 240 | Estructura simple, reducción de costos. |

Fácil de quemar, baja sensibilidad.7 |

| Aumento del rendimiento | Plumbicón | década de 1960 | 400+ | SNR alta, retraso bajo |

muy caro8 |

| Pico analógico | Newvicon/Saticon | década de 1970 | 480-700 | Capacidad temprana en condiciones de poca luz |

Aún grande, depende de la alimentación de CA10 |

El momento Nobel del silicio: el nacimiento y el reinado del CCD

1969 marcó un hito en la historia moderna de la imagen. Willard Boyle y George Smith de los Laboratorios Bell inventaron el dispositivo de carga acoplada (CCD), un logro que más tarde les valió el Premio Nobel de Física.13El CCD revolucionó el hardware de las cámaras de seguridad, reemplazando los frágiles tubos de vacío con chips de silicio de estado sólido.13

El arte del acoplamiento de carga: la analogía del cubo de agua

El principio de funcionamiento de un CCD se puede comparar con un "conjunto de cubos que recogen el agua de lluvia". Cada píxel (átomo de silicio) del sensor actúa como un cubo que recoge fotones (gotas de lluvia). El efecto fotoeléctrico convierte los fotones en fotoelectrones, que se almacenan en pozos de potencial. Durante la etapa de lectura, estas cargas se mueven fila por fila como una carrera de relevos hasta un amplificador de lectura y se convierten en voltaje.13La ventaja del CCD radica en su alta uniformidad de imagen y bajo ruido de patrón, ya que todos los píxeles suelen compartir de uno a cuatro amplificadores de lectura, lo que garantiza la coherencia.13

Fairchild Semiconductor lanzó el primer CCD comercial del mundo, el MV-100, en 1973, con una resolución de sólo 100x100 píxeles.14Aunque inicialmente estaba destinado a uso industrial y militar, allanó el camino para las cámaras de seguridad "de bolsillo".16Sony invirtió la asombrosa cantidad de 20 mil millones de yenes en investigación y desarrollo a lo largo de la década de 1970, y finalmente comercializó la cámara CCD en color XC-1 en 1980.18Esta medida, considerada una apuesta suicida en ese momento, estableció a Sony como la fuerza dominante en el mercado global de sensores de imagen durante décadas.19

La edad de oro de la monitorización analógica y la evolución de las PCB

Durante el reinado del CCD en las décadas de 1980 y 1990, la electrónica interna de la cámara también experimentó cambios radicales. La tecnología de placas de circuito impreso (PCB) pasó del papel fenólico a sustratos de fibra de vidrio, mejorando enormemente la estabilidad térmica y la integridad de la señal.6En la década de 1970, los PCB solo admitían cableado de un solo lado; En la década de 1980, los PCB de doble cara permitieron integrar más componentes de procesamiento de señales (como los primeros procesadores de video) en carcasas de cámaras pequeñas.6Durante este período, los sistemas de seguridad utilizaban cables coaxiales para transmitir señales analógicas, con una resolución que alcanzaba el límite físico de la tecnología analógica: aproximadamente 700 líneas de TV (TVL).5

CMOS APS y la revolución digital: de la "captura" a la "computación"

Si bien el CCD lideró la calidad de imagen durante mucho tiempo, su compleja fabricación, su alto consumo de energía y su incapacidad para integrar circuitos lógicos limitaron una mayor inteligencia de la cámara. A mediados de la década de 1990, la tecnología del sensor de píxeles activo semiconductor complementario de óxido metálico (CMOS APS) comenzó a madurar.13

La batalla arquitectónica: CMOS versus CCD

A diferencia de la "lectura en serie" del CCD, cada píxel de un sensor CMOS tiene su propio amplificador y circuito de lectura. Esta arquitectura proporciona múltiples ventajas técnicas:

-

Alta Integración:Los procesadores de señal de imagen (ISP), los convertidores analógico-digital (ADC) y los circuitos de control de temporización se pueden integrar en el mismo chip de silicio, formando un sistema en chip (SoC).21

-

Velocidad ultraalta:Con miles de canales de lectura, las velocidades CMOS pueden ser 100 veces más rápidas que las CCD, lo que permite monitoreo de alta velocidad de fotogramas (60 fps o más) y reproducción en cámara lenta.13

-

Control de potencia:CMOS consume una cantidad significativa de energía solo durante la conmutación de píxeles, lo que reduce drásticamente el calor, un factor crítico para las operaciones de seguridad 24 horas al día, 7 días a la semana.13

En 2007, CMOS alcanzó la paridad de mercado con CCD y, en 2019, con la popularidad de la tecnología retroiluminada (BSI), el rendimiento de CMOS superó a CCD.13BSI reordena las capas del sensor para que la luz llegue al fotodiodo antes que a la capa del circuito, lo que aumenta drásticamente la eficiencia cuántica (QE) y sienta las bases para la vigilancia "Starlight".14

La siguiente tabla compara CCD y CMOS en aplicaciones de seguridad modernas:

| Parámetro | Sensor CCD | Sensor CMOS (APS) | Impacto en las tendencias |

| Velocidad de lectura | 1 - 40 MPS | 100 - 400+ MPS |

Transmisión de video HD habilitada13 |

| Leer ruido | 5 - 10 electrones | 1 - 3 electrones |

Claridad mejorada en condiciones de poca luz13 |

| Rango dinámico | Alto (fotograma completo) | Extremadamente alto (HDR) |

Avances facilitados en el WDR15 |

| Costo | Alta (Líneas especializadas) | Bajo (CMOS estándar) |

Impulsó la democratización de las cámaras13 |

| Integración | Bajo (chips externos) | Alto (SoC de un solo chip) |

Cámaras Led to Edge AI22 |

Evolución de las lentes ópticas: del vidrio fijo a los sistemas inteligentes

Si el sensor es la "retina" de una cámara, la lente es su "lente cristalino". En seguridad, las lentes deben mantener el poder de resolución en entornos altamente variables.

Superar la aberración: el auge de los elementos asféricos

Las primeras lentes de seguimiento eran en su mayoría esféricas. La naturaleza física de las lentes esféricas significa que los rayos de luz en los bordes y el centro no convergen en el mismo punto, lo que provoca aberración esférica y desenfoque de los bordes.26Para solucionar esto, las lentes de seguridad comenzaron a adoptar en masa elementos asféricos. Aunque la teoría fue propuesta por Descartes en 1637, no fue hasta la década de 1980 que el moldeado de vidrio de precisión hizo posible la producción en masa, permitiendo aperturas más grandes (F/1,4 o F/1,0) sin sacrificar la claridad.27

Zoom y corrección automática de enfoque posterior

En la década de 1970, la necesidad de ángulos de visión flexibles llevó al nacimiento de las lentes con zoom. Sin embargo, los objetivos con zoom tradicionales suelen perder el enfoque durante los cambios de distancia focal. Para garantizar la claridad, la industria desarrolló mecanismos de "Ajuste de enfoque posterior" para mantener el enfoque bloqueado en el plano del sensor desde los extremos gran angular hasta teleobjetivo.29Los lentes de zoom motorizados modernos incorporan motores paso a paso de precisión para ajustar automáticamente el campo de visión según los activadores de alarma.26

P-iris: resolviendo el dilema de la difracción en la era HD

A medida que la resolución del sensor saltó de 0,3 MP a 8 MP (4K), surgieron los defectos de las lentes de iris automático tradicionales. Los iris DC convencionales sólo ajustan el tamaño de apertura según el brillo. En ambientes brillantes, el iris se cierra tan fuertemente que causa una severa difracción, desenfocando la imagen, un fenómeno conocido como "límite óptico".30

Para contrarrestar esto, Axis Communications introdujo la tecnología P-iris (Precise Iris). P-iris no depende únicamente de sensores de luz; Utiliza software para comunicarse con un motor paso a paso en la lente.

-

Selección de apertura óptima:El software identifica el "punto óptimo" de la lente (generalmente un diafragma de rango medio) y lo mantiene tanto como sea posible.30

-

Vinculación de ganancia y exposición:Cuando la luz es demasiado intensa, el sistema prioriza una exposición más corta o una reducción de ganancia electrónica en lugar de cerrar excesivamente el iris, evitando así la difracción.30

-

Profundidad de campo maximizada:Para escenas como pasillos largos, P-iris optimiza la profundidad de campo para garantizar que tanto el primer plano como el fondo permanezcan claros.33

Avance de los ISP: el auge del nervio óptico digital

Los datos sin procesar del sensor deben ser procesados por un procesador de señal de imagen (ISP) para que sean visibles. La evolución del ISP es lo que hizo que el monitoreo de seguridad pasara de "ver" a "ver con claridad y precisión".

Caminos técnicos hacia el amplio rango dinámico (WDR)

En escenas a contraluz (como la ventana de un banco), la diferencia entre las áreas brillantes y oscuras puede superar los 100.000x. Los ISP manejan esto a través de tres métodos principales:

-

WDR digital (DWDR):Un algoritmo de software que ajusta las curvas gamma para iluminar áreas oscuras. Bajo costo pero alto ruido.35

-

Verdadero WDR (fusión de exposición múltiple):La solución convencional de alta gama. El ISP indica al sensor que tome dos fotogramas en rápida sucesión: una exposición corta (aclaraciones) y una exposición larga (sombras). El registro a nivel de píxel los fusiona a la perfección.36

-

WDR forense:Una versión optimizada para reducir los artefactos de movimiento, asegurando que los objetos en movimiento no tengan "efecto fantasma", lo cual es fundamental para el reconocimiento de matrículas.25

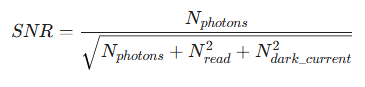

La relación señal-ruido (SNR) en los algoritmos de ISP se puede describir mediante:

Avances extremos en condiciones de poca luz: luz estelar y luz negra

La última frontera de la seguridad es la oscuridad. La visión nocturna por infrarrojos tradicional provoca la pérdida de color, lo que hace imposible identificar los colores de la ropa o del vehículo.40

Los tres pilares del hardware de las cámaras "Starlight"

El éxito de Starlight depende de superar los límites físicos:

-

Sensores de gran formato:Utilizando sensores de 1/1,8 pulgadas o incluso de 1/1,2 pulgadas. Esto aumenta el área receptora de luz por píxel, capturando más fotones.39

-

Óptica de apertura ultragrande:Equipado con lentes F/1.0 o F/0.95, que proporcionan 4 veces la entrada de luz de las lentes estándar F/2.0.26

-

Algoritmos de obturación lenta:Apilamiento de frames en el ISP para aumentar el tiempo de integración. Si bien esto introduce algo de desenfoque por movimiento, produce imágenes en color diurnas en entornos de 0,001 Lux.24

Blacklight (DarkFighter X) Fusión de doble sensor

Cuando la luz cae por debajo de 0,0001 Lux, la ganancia por sí sola es insuficiente. Fabricantes como Hikvision (DarkFighter X) y Keda lanzaron la tecnología Blacklight, que imita los bastones y conos del ojo humano:

-

División óptica:Un prisma especializado divide la luz en trayectorias infrarrojas y visibles.44

-

Sensores duales:Un sensor captura IR (luminancia y detalle), mientras que el otro captura luz visible débil (color).

-

Fusión a nivel de píxel:El ISP adapta las dos rutas en tiempo real, generando vídeo brillante, a todo color y con poco ruido. Esto requiere una precisión de calibración de subpíxeles.44

Sinergia de lentes múltiples e imágenes computacionales: una nueva era

La monitorización moderna está yendo más allá de una perspectiva única hacia plataformas de fusión de múltiples sensores.

Empalme panorámico (PanoVu) y enlace de lente dual (TandemVu)

Para cubrir áreas extensas como plazas o aeropuertos, la serie PanoVu de Hikvision integra de 4 a 8 sensores. Los algoritmos del ISP realizan "costuras perfectas", que incluyen:

-

Consistencia de exposición:Garantizar que el brillo sea uniforme en todos los sensores.45

-

Registro de píxeles:Eliminando puntos ciegos y fantasmas en las costuras.45

-

Monitoreo multidireccional:Una dirección IP y un cable pueden gestionar una vista de 360 grados, lo que reduce los costos del sistema.47

Fotografía computacional e iluminación inteligente

Las imágenes computacionales están desdibujando la línea entre hardware y software.

-

Luz híbrida inteligente:Las cámaras como la Smart Hybrid Light de Hikvision utilizan IA para cambiar del modo IR discreto al modo de color de luz blanca cuando se detecta una persona o un vehículo.41

-

Fusión multiespectral:Fusión térmica (LWIR) y luz visible. La térmica detecta el calor (objetivos ocultos), mientras que la visible los identifica, mejorando enormemente la precisión de la protección perimetral.51

Visión 2030: El futuro disruptivo del hardware de seguridad

De cara al año 2030, la forma de las cámaras de seguridad sufrirá otro cambio cualitativo.

Imágenes sin lentes y sensores cuánticos

Las investigaciones sugieren que las "cámaras sin lentes" basadas en óptica computacional están madurando. Al utilizar codificadores ópticos delgados en lugar de lentes de vidrio, las cámaras pueden volverse tan delgadas como pegatinas.20Además, los diodos de avalancha de fotón único (SPAD) permitirán obtener imágenes en condiciones de luz cero (conteo de fotones).20

Reconocimiento de emociones e intenciones

Para 2030, las cámaras no serán sólo herramientas visuales:

-

Monitoreo Biométrico:Uso de vibrómetros láser Doppler de largo alcance para capturar los latidos del corazón y la respiración.55

-

Análisis de emociones:Las redes neuronales profundas analizarán microexpresiones y lenguaje corporal para realizar una "predicción de intención" antes de que ocurra un delito.55

-

Autonomía de borde:Con 5G/6G y chips de inteligencia artificial de bajo consumo, las cámaras actuarán como "guardias digitales", realizando todos los análisis localmente y cargando datos cifrados a través de protocolos cuánticos.3

Conclusión: Un siglo resumido en luces y sombras

La evolución de las cámaras de seguridad es una historia de la búsqueda interminable de "visibilidad" por parte de la humanidad. Desde una máquina búnker de 1942 hasta la terminal actual impulsada por IA con fusión a nivel de píxeles y visión nocturna en color, cada paso ha sido un triunfo sobre los límites físicos. Las lentes pasaron de esféricas a asféricas y los iris de manuales a P-iris; los sensores pasaron de tubos voluminosos a BSI CMOS y hacia la detección cuántica; La tecnología de PCB pasó de conexiones simples a plataformas SoC de alto rendimiento.

El futuro de la seguridad no será una colección de hardware frío sino una fusión de física, semiconductores e inteligencia artificial. Mientras se protege a la sociedad, el verdadero desafío para la próxima década será encontrar el equilibrio entre el progreso tecnológico y la ética de la privacidad.